ついに来た!Googleの「本気」が詰まったGemma 4

個人開発者の皆さん、準備はいいですか?

Googleから、これまでで最も知能の高いオープンモデル「Gemma 4」がついにリリースされました!

「オープンモデルって、結局商用だと制限があるんでしょ?」と思っていたあなた。

これこれー!

今回のGemma 4は、なんとApache 2.0ライセンス。

つまり、私たちが作ったアプリに組み込んで自由にビジネスができる、真の自由を手に入れたモデルなんです。

初代Gemmaから4億回以上のダウンロードを経て、コミュニティの声を反映して爆誕したこのモデル。

何がそんなに凄いのか、中級者目線でサクッと解説していきますね。

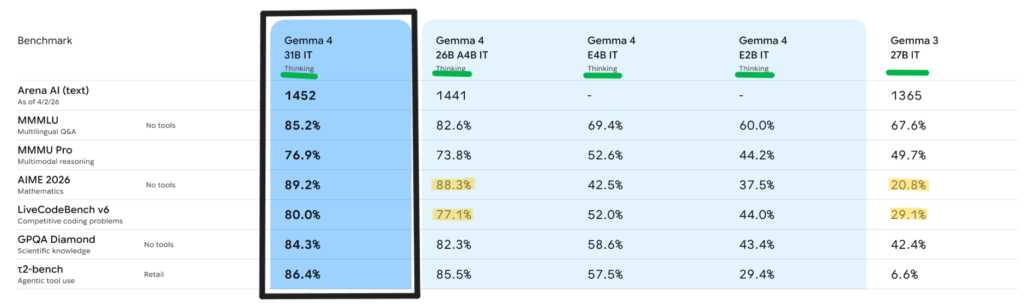

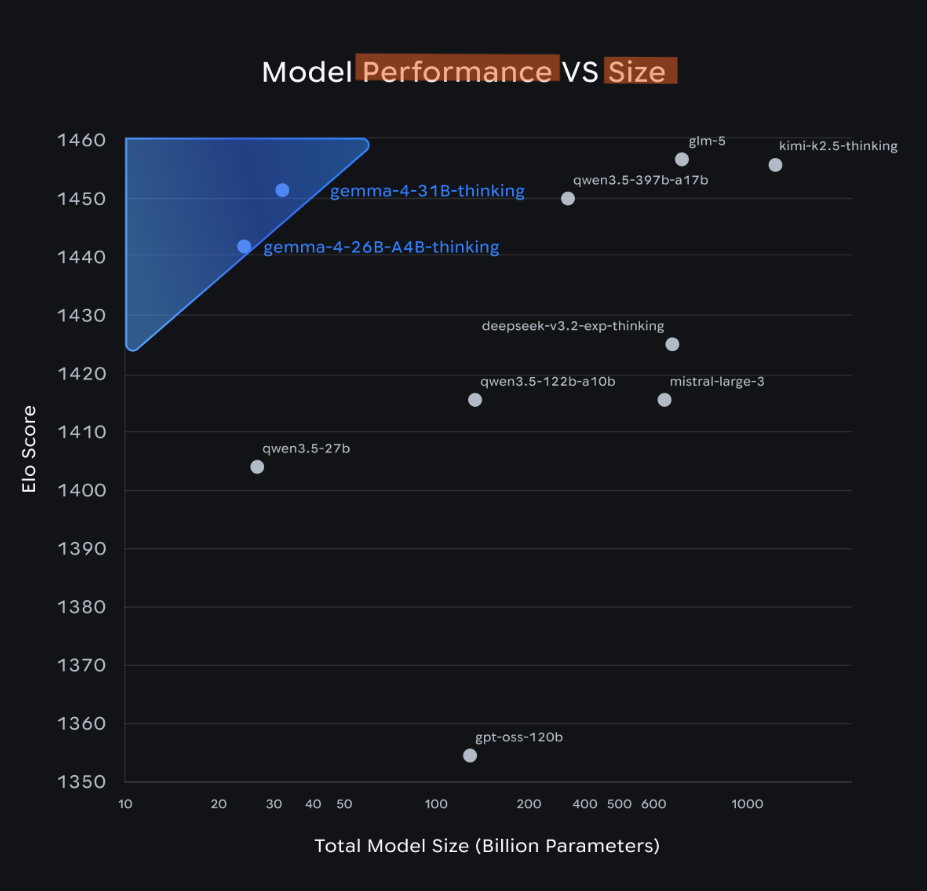

驚異のベンチマーク!サイズを超えた「知能」の証明

まず驚くのが、その圧倒的なパフォーマンスです。

Arena.aiのチャットアリーナ(4月1日時点)では

31B(310億パラメータ)モデルがオープンモデル部門で世界第3位にランクイン。

26Bモデルも第6位に食い込んでいます。

特筆すべきは、自分たちの20倍以上のサイズを持つモデルすら凌駕している点。

これこれー!

効率の良さが異常なんです。重いサーバーを借りなくても、手元のハードウェアでフロンティア級の知能を動かせる。

これこそ個人開発者が求めていた「武器」だと思いませんか?

4つのモデル展開:どれを選ぶのが正解?

Gemma 4は、用途に合わせて4つのサイズが用意されています。ここ、自分の開発スタイルに合わせて選ぶのがポイントです。

1. 26B MoE & 31B Dense(デスクトップ・サーバー向け)

研究者やガチの開発者向け。31Bは最高品質、26B(Mixture of Experts)は推論速度を重視。

80GBのNVIDIA H100なら余裕、量子化すれば一般のゲーミングPCでもネイティブ動作します。

企業向けではありますがローカルでGeminiレベルのAIを動かせるのは夢がありますね!!

2. E2B & E4B(モバイル・IoT向け)

「Effective 2B/4B」の名の通り、スマホやRaspberry Piでの動作に特化。

これこれー!

低遅延でオフライン動作するAIアプリを作るなら、間違いなくこのサイズが主役になります。

筆者の感想

早速使ってみたところ、e2bモデルでも精度が高いと感じました。

具体的には、画像を読み込ませてテキストを生成するシステムで使ってみました。

ollamaからDLしてコードにセッティング。言語は、Pythonです。

Tomoya

Tomoya簡単なシステムなのでそんなに苦労せずに作れます。ぜひ試してみて!

ちゃんと画像認識では重要なdetailを掴んでいて、テキスト内容に関しても自分が見ている感じと一致しているのが、他の同じ容量をもつオープンソースモデルとは違うなと感じました。

多彩な機能:ただのテキストAIじゃない!

Gemma 4は「何でも屋」です。以下の機能が最初からネイティブサポートされています。

- 高度な推論:多段階の計画が必要な複雑なタスクもこなせます。

- エージェント型ワークフロー:JSON出力や関数呼び出しに強く、他のAPIと連携するAIエージェントが作りやすい!

- コード生成:オフラインで動く最強のコーディングアシスタントになります。

- マルチモーダル:画像、動画はもちろん、小型モデル(E2B/E4B)は音声認識までサポート。

- 140以上の言語:世界中で使われるアプリもこれ一つでOK。

Googleといったらマルチモーダル!

画像や動画、音声認識もこのオープンソースモデルでも使えるのは大きいと思いませんか?

開発環境との親和性が抜群すぎる件

Google製だからといって、Google Cloudに縛られる必要はありません。

Hugging Face、Ollama、llama.cpp、NVIDIA NIMなど、主要なツールは初日から対応済み。

自分の慣れ親しんだ環境で、今すぐダウンロードして試せます。

特にAndroid開発者なら、Android Studioのエージェントモードで今すぐプロトタイプ作成が可能です。

Pixelデバイスでサクサク動くAI、夢が広がりますよね。

まとめ:個人開発の「新時代」が始まった

「Gemma 4」は、高い知能、自由なライセンス、そして多様なハードウェアへの適応力を兼ね備えた、まさに個人開発者のための神モデルです。

高性能な推論能力をローカルで、しかもApache 2.0で使える。

これこれー!このチャンスを逃す手はありません。

まずはHugging FaceやOllamaでモデルを落として、その凄さを体感してみてください。

参照:https://blog.google/innovation-and-ai/technology/developers-tools/gemma-4/

終わりに

この発表に正直、Tomoya自身興奮しています。

Gemmaシリーズは、モバイルでの利用に特化しているイメージがありましたが今回の内容を見てメインでも使えるなと強く思いました。

画像や音声の認識のレベルが高いと感じているので信頼度が高いです。これからローカルで動かす時は、積極的に使っていきたいと思っています。

26Bや31Bを使えるスペックのPCは持っていないですがいつか使ってみたいなと思いました。

知識量+マルチモーダル+推論が組み合わさったモデルは、強すぎます。それを無料で使えるなんて…と思ってしまいます。

Tomoya

コメント